Nel panorama dell’informazione contemporanea, la diffusione di immagini generate dall’intelligenza artificiale rappresenta una delle trasformazioni più significative e, al tempo stesso, più insidiose. Strumenti sempre più sofisticati consentono di creare fotografie realistiche in pochi secondi, rendendo difficile distinguere ciò che è autentico da ciò che è frutto di un algoritmo. In un contesto in cui la fiducia nelle immagini è storicamente elevata, saper riconoscere i segnali di una generazione artificiale diventa una competenza essenziale per giornalisti, professionisti della comunicazione e cittadini.

L’illusione della perfezione: quando l’AI imita la realtà

Le tecnologie di generazione visiva, basate su modelli di deep learning come le reti neurali generative, sono oggi in grado di produrre immagini estremamente realistiche. Questi sistemi apprendono analizzando milioni di fotografie e riescono a riprodurre texture, luci e prospettive con una precisione sorprendente. Tuttavia, nonostante i progressi, persistono imperfezioni che possono rivelare l’origine artificiale di un’immagine.

L’apparente perfezione, infatti, spesso nasconde incongruenze difficili da individuare a una prima osservazione. Un’analisi più attenta consente invece di cogliere elementi sospetti, offrendo preziosi indizi sull’autenticità del contenuto visivo.

Le mani: il dettaglio che tradisce l’algoritmo

Uno dei segnali più evidenti riguarda la rappresentazione delle mani. Storicamente, i modelli di intelligenza artificiale hanno mostrato difficoltà nel riprodurre correttamente questa parte del corpo umano. È possibile osservare dita in numero errato, posizioni innaturali, fusioni tra le dita o proporzioni incoerenti rispetto al resto del corpo.

Anche quando il numero delle dita è corretto, possono emergere anomalie come articolazioni poco definite o un’integrazione imperfetta con gli oggetti circostanti. Per questo motivo, un controllo accurato delle mani rappresenta uno dei primi passaggi per verificare la natura di un’immagine.

Ombre e illuminazione: la coerenza della luce

Un altro elemento chiave riguarda la gestione della luce. Le immagini generate artificialmente possono presentare ombre incoerenti con la direzione della fonte luminosa o con la posizione degli oggetti nella scena. Talvolta le ombre risultano troppo morbide, assenti o orientate in modo incompatibile tra loro.

La riflessione della luce su superfici come vetro, acqua o metallo costituisce un ulteriore indicatore. In una fotografia reale, questi effetti seguono precise leggi fisiche, mentre nelle immagini create dall’AI possono apparire distorti o poco credibili. Analizzare attentamente questi aspetti consente di individuare discrepanze che sfuggono a un’osservazione superficiale.

Testi e dettagli complessi: quando la precisione vacilla

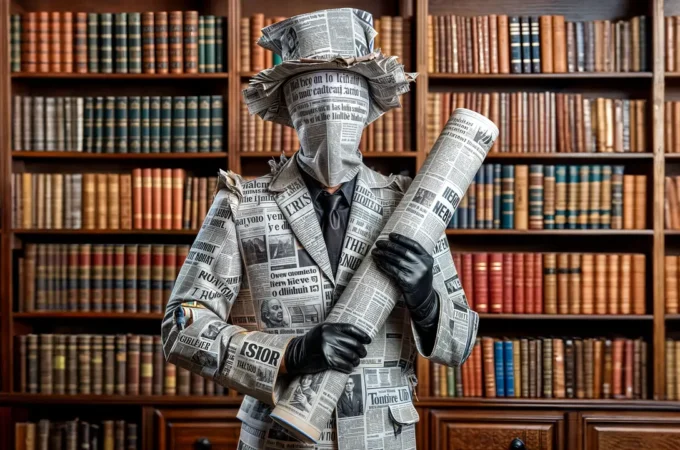

Nonostante l’elevato livello di realismo, l’intelligenza artificiale incontra ancora difficoltà nella riproduzione di elementi complessi come scritte, loghi o simboli. Le immagini generate possono contenere parole prive di significato, caratteri deformati o sequenze di lettere incoerenti.

Analogamente, pattern ripetitivi come tessuti, capelli o elementi architettonici possono mostrare irregolarità o duplicazioni innaturali. Questi difetti derivano dal modo in cui i modelli generativi ricostruiscono le informazioni visive, basandosi su probabilità statistiche piuttosto che su una reale comprensione del contesto.

I detector di immagini AI: strumenti utili ma non infallibili

Per contrastare la diffusione di contenuti sintetici, sono stati sviluppati diversi strumenti di rilevamento automatico. I cosiddetti AI image detector analizzano caratteristiche statistiche e pattern invisibili all’occhio umano per stabilire se un’immagine sia stata generata artificialmente.

Tra i più noti si trovano piattaforme come Hive Moderation, Illuminarty e AI or Not. Sebbene rappresentino un valido supporto, questi strumenti non garantiscono una precisione assoluta. I risultati devono essere interpretati con cautela e integrati con un’analisi visiva e contestuale.

Metadati e filigrane digitali: le tracce invisibili

Oltre all’analisi visiva, un ulteriore metodo di verifica consiste nell’esame dei metadati dell’immagine. Le informazioni EXIF (Exchangeable Image File Format) possono rivelare dettagli sulla fotocamera utilizzata, sulla data di scatto e sulle eventuali modifiche apportate al file. L’assenza di tali dati o la presenza di informazioni incoerenti può suggerire un’origine artificiale.

Alcune aziende stanno inoltre introducendo sistemi di filigrana digitale invisibile per certificare la provenienza dei contenuti. Un esempio significativo è rappresentato dalla tecnologia Content Credentials, promossa dalla Content Authenticity Initiative, che consente di tracciare la storia di un’immagine e verificarne l’autenticità.

Il ruolo dell’alfabetizzazione digitale

La crescente diffusione delle immagini generate dall’AI impone una riflessione più ampia sul tema dell’alfabetizzazione mediatica. Non si tratta soltanto di disporre di strumenti tecnologici avanzati, ma anche di sviluppare una cultura critica capace di interpretare i contenuti digitali.

Nel giornalismo, in particolare, la verifica delle fonti visive diventa un passaggio imprescindibile per garantire l’affidabilità dell’informazione. L’uso consapevole delle immagini e la capacità di riconoscere eventuali manipolazioni rappresentano oggi competenze fondamentali per preservare l’integrità del dibattito pubblico.

Verso un futuro di immagini sempre più credibili

L’evoluzione dell’intelligenza artificiale renderà progressivamente più difficile distinguere tra immagini reali e sintetiche. I modelli generativi stanno già riducendo molte delle imperfezioni che in passato ne tradivano l’origine. Di conseguenza, il processo di verifica dovrà basarsi su un approccio multidisciplinare che integri osservazione visiva, analisi tecnica e valutazione del contesto.

In questo scenario, la collaborazione tra istituzioni, aziende tecnologiche e comunità scientifica sarà determinante per sviluppare standard condivisi e strumenti sempre più efficaci. Solo attraverso un impegno congiunto sarà possibile preservare la fiducia nelle immagini e contrastare il rischio di disinformazione.

Un nuovo paradigma della fiducia visiva

La capacità di riconoscere un’immagine generata dall’intelligenza artificiale non è più una competenza riservata agli esperti, ma una necessità per chiunque navighi nello spazio digitale. Dall’osservazione delle mani alla verifica delle ombre, dall’utilizzo dei detector all’analisi dei metadati, ogni elemento contribuisce a costruire un processo di valutazione più consapevole.

In un’epoca in cui la realtà può essere ricreata con estrema facilità, il vero valore risiede nella capacità di interrogare criticamente ciò che vediamo. Solo così sarà possibile mantenere saldo il confine tra verità e finzione, garantendo un’informazione trasparente e affidabile.